Giải mã vì sao AI thông minh vẫn tính sai: Nghiên cứu mới hé lộ

AI Không Thể Tư Duy Toán Học Vì Không Hiểu Bản Chất, Dễ Xao Nhãng

Trong những năm gần đây, công nghệ AI đã thu hút sự chú ý lớn với khả năng lý luận và tư duy ngày càng được cải thiện. Các hệ thống máy học (machine learning), mô hình ngôn ngữ và chatbot AI được quảng bá rộng rãi bởi những tập đoàn lớn như OpenAI và Google. Chúng được mô tả như những trợ lý ảo thông minh, phục vụ hàng tỷ người trên toàn cầu thông qua các thiết bị như smartphone, laptop, và thậm chí kính thông minh trong tương lai.

Tuy nhiên, một nghiên cứu gần đây của sáu kỹ sư đến từ Apple đã chỉ ra rằng khả năng tư duy toán học và logic của nhiều mô hình ngôn ngữ lớn (LLM) hiện tại không được như mong đợi. Họ xác định rằng những LLM này, mặc dù được quảng cáo mạnh mẽ, thực tế vẫn kém và không đáng tin cậy trong việc giải quyết các vấn đề toán học.

Kết Quả Nghiên Cứu

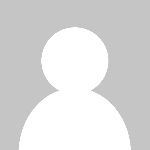

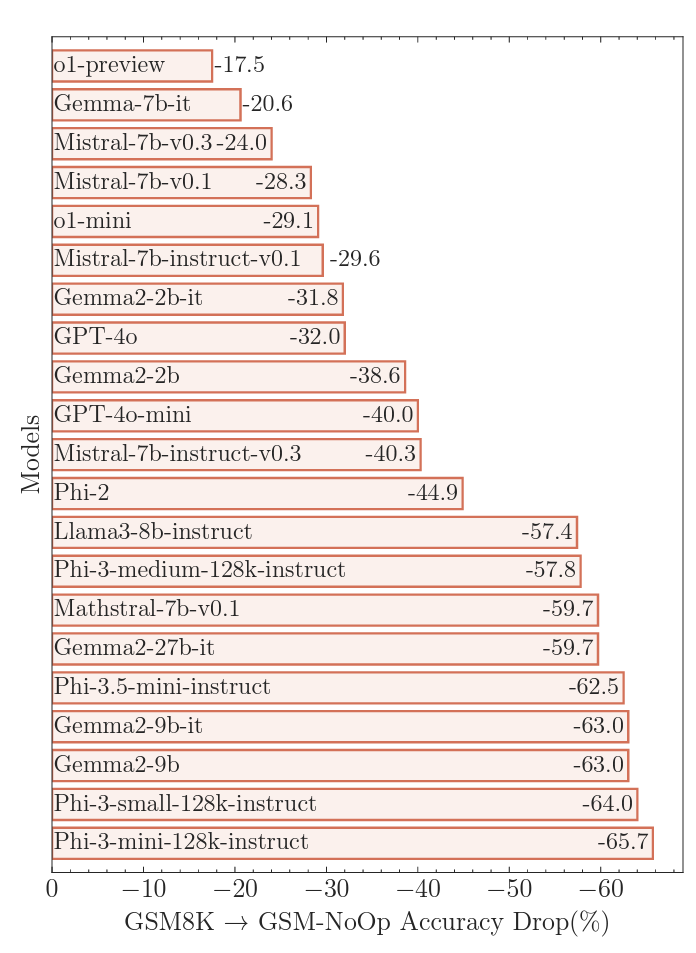

Nghiên cứu sử dụng bộ dữ liệu bài kiểm tra toán học GSM8K, chứa 8.000 câu hỏi toán học cấp trung học, để đánh giá khả năng tính toán của những LLM hiện đại. Thay vì để các mô hình này giải quyết trực tiếp, các nhà nghiên cứu đã thay đổi một phần thông tin trong câu hỏi. Ví dụ, câu hỏi "Sophie có 31 viên gạch đưa cho em" được biến đổi thành "Bill có 19 viên gạch đưa cho anh". Việc này giúp đảm bảo tính khách quan và không làm ảnh hưởng đến độ khó của bài toán.

![[IMG]](https://photo2.tinhte.vn/data/attachment-files/2024/10/8483904_gsm-study1-1440x629.png)

Kết quả cho thấy, tỷ lệ đưa ra lời giải chính xác của các LLM sau khi phải tư duy logic giảm đáng kể. Cụ thể, tỷ lệ chính xác của GPT-4o giảm từ 0,3% và thậm chí Mistral 7B có tỷ lệ lên tới 9,2%. Chênh lệch giữa các LLM cũng cho thấy rằng việc thay đổi dữ kiện trong bài toán khiến cho khả năng tính toán của chúng trở nên yếu kém hơn.

Vấn Đề Xao Nhãng Trong Tư Duy

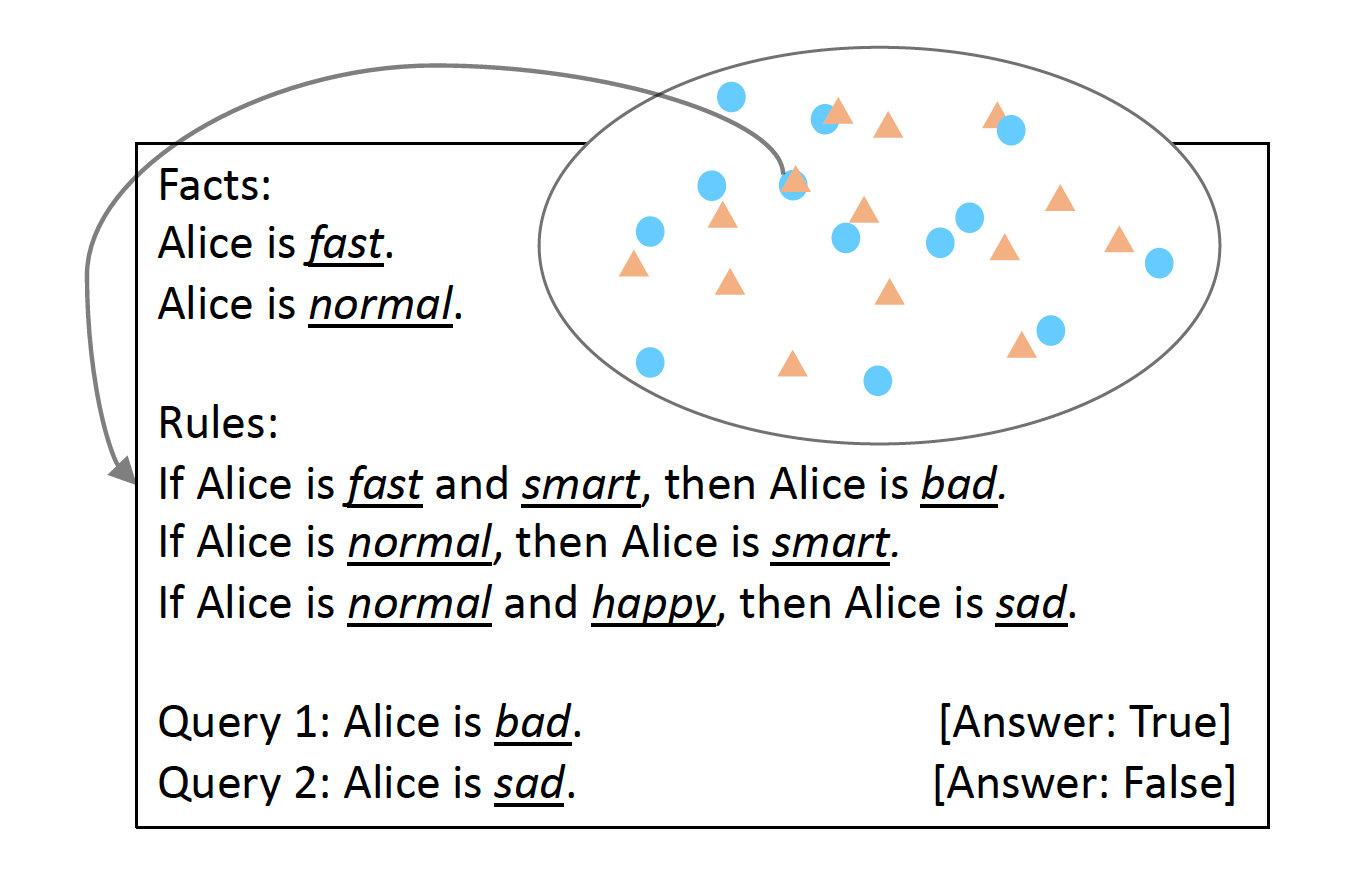

Một điểm thú vị khác được phát hiện là khi thêm những thông tin không liên quan vào câu hỏi, tỷ lệ trả lời đúng của LLM giảm mạnh. Chẳng hạn, khi một câu hỏi đơn giản về số trái cây được kèm theo thông tin vô nghĩa như "5 trái trong số đó nhỏ hơn mức trung bình," nhiều LLM đã không thể trả lời đúng. Kết quả này củng cố nhận định rằng LLM không thể tư duy mà chỉ đơn thuần là “pattern matching” dựa trên dữ liệu đã được huấn luyện.

Điều này dẫn đến một kết luận quan trọng: khả năng toán học của AI vẫn còn hạn chế. Thay vì lý luận và giải quyết vấn đề một cách sáng tạo, LLM thường bị phân tâm bởi những thông tin không liên quan và thực hiện sai sót trong những bài toán tưởng chừng đơn giản.

Tương Lai của AI Trong Tư Duy

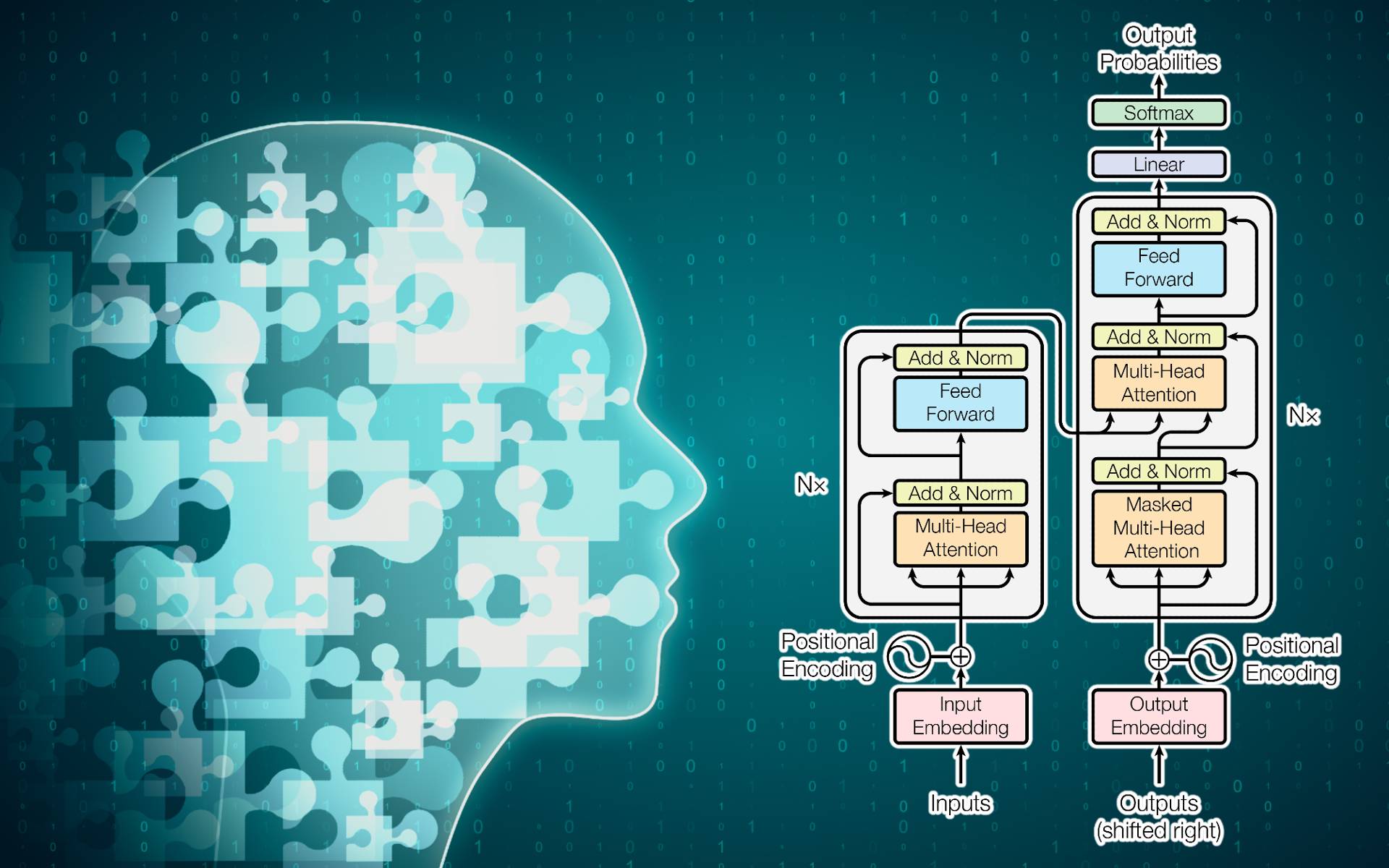

Nghiên cứu này nhấn mạnh rằng dù cho mô hình như GPT-4 có vẻ rất ấn tượng trong khả năng nội suy văn bản, thực tế chúng không có khả năng hiểu biết và tư duy toán học. Theo các chuyên gia, bước tiến lớn tiếp theo trong công nghệ AI sẽ chỉ đến khi những mạng nơ-ron có thể tích hợp những thao tác xử lý ký hiệu và mô tả kiến thức theo cách trừu tượng, như trong môn đại số.

Cho đến khi có những cải tiến đó, AI sẽ vẫn chỉ có thể “lý luận” bằng cách bắt chước lại mọi ví dụ đã được học. Điều này có thể khiến cho một số bài toán đơn giản thậm chí còn khó khăn hơn so với các máy tính cầm tay phổ biến hiện nay.

Kết Luận

Nghiên cứu của các kỹ sư Apple không chỉ khẳng định lại những hạn chế của AI trong việc tư duy toán học mà còn mở ra hướng đi mới cho việc phát triển công nghệ này. Việc hiểu bản chất và lý thuyết toán học vẫn là một thách thức lớn, đòi hỏi các nhà nghiên cứu phải nỗ lực nhiều hơn để cải tiến khả năng của AI trong tương lai.

![[Trên Ghế 28] ‘Tối nay đi chơi với anh, đừng về’ và những góc khuất nghề sales nữ bán ô tô - CÔNG NGHỆ](https://cryptocloud9.io/uploads/images/202410/image_430x256_671254d78b43e.jpg)